Předpovědi Safetica v oblasti ochrany dat pro rok 2024

Jaké jsou trendy v kybernetické bezpečnosti pro rok 2024? Cloudová ochrana dat, stínové IT a rostoucí využití AI v zabezpečení dat. Podívejte se na...

Nadcházející přijetí EU AI Act je začátkem transformační éry v oblasti správy AI. Klade důraz na přístup založený na riziku k regulaci nasazení a používání AI systémů v celé Evropské unii, ale bude mít celosvětové důsledky.

Toto nařízení má význam, neboť ovlivní, jak budou firmy procházet světem umělé inteligence, a soulad nebude procházka růžovou zahradou. Stejně jako tým studuje pravidla před zápasem, musí se firmy seznámit s AI Act, aby zajistily, že hrají podle předpisů a vyhnuly se případným sankcím po skončení přechodného období AI Act (stanoveného na konec roku 2025 nebo začátek roku 2026).

Začněme tedy od začátku. Co je EU AI Act, jaký je jeho rozsah a jak se na něj mohou organizace připravit?

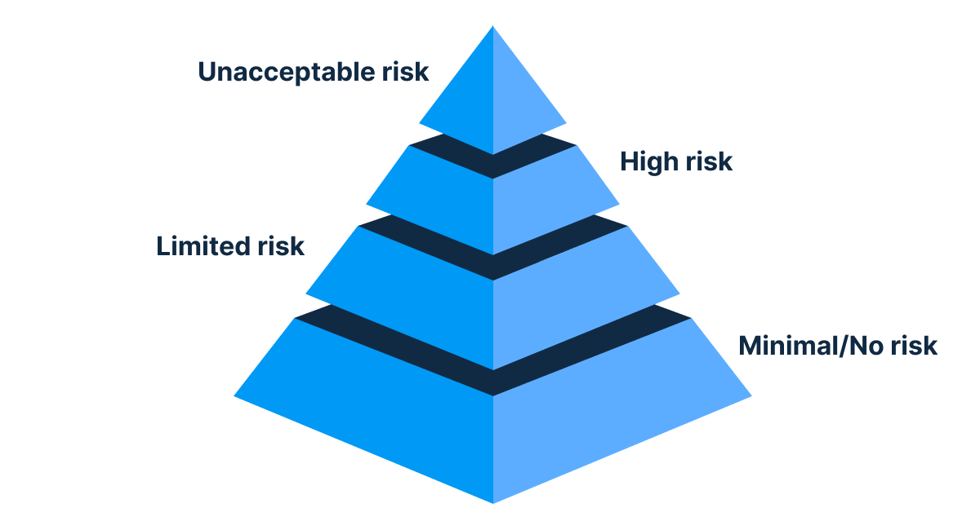

Podobně jako obecné nařízení o ochraně osobních údajů (GDPR), které přineslo komplexní zákony o ochraně dat do EU, si AI Act klade za cíl stanovit pokyny pro AI technologie a řešit potenciální rizika spojená s umělou inteligencí. Toto nařízení používá přístup založený na riziku a kategorizuje AI systémy podle úrovně rizika, které představují.

Je důležité si uvědomit, že AI Act není o ochraně světa před vymyšlenými konspiračními teoriemi nebo přitaženými scénáři. Místo toho se zaměřuje na praktická hodnocení rizik a předpisy, které řeší hrozby pro pohodu jednotlivců a základní práva.

Legislativní cesta tohoto přelomového nařízení začala jeho návrhem v dubnu 2021. Od té doby prošlo důkladnými diskusemi, vyjednáváními a úpravami v rámci legislativních orgánů EU. Evropský parlament mu v červnu 2023 dal zelenou a má být finalizováno na začátku roku 2024.

Po přijetí AI Act začne přechodné období minimálně 18 měsíců, než se stane plně vymahatelným. Během tohoto období budou společnosti a organizace pracovat na sladění svých AI systémů a postupů s požadavky uvedenými v AI Act.

Akt nebude mít dopad pouze na subjekty v rámci EU, ale také na globální dodavatele prodávající nebo zpřístupňující své systémy uživatelům EU. Stejně jako GDPR je to nařízení vytvořené EU a pro EU, ale ovlivní organizace po celém světě.

I když to může znít, jako by se EU připravovala na bitvu proti robotům přebírajícím svět, skutečným účelem AI Act je něco prozaičtějšího: ochrana zdraví, bezpečnosti a základních práv jednotlivců interagujících s AI systémy. Snaží se udržet vyvážené a spravedlivé prostředí pro nasazení a využití AI technologií.

Představte si to jako knihu vodicích zásad, která zajišťuje, že AI systémy hrají podle pravidel, dodržují etické pokyny a upřednostňují pohodu uživatelů a společnosti. Slouží jako proaktivní opatření k zabránění tomu, aby se AI stala scénářem Divokého západu, kde si může každý dovolit cokoli, a místo toho podporuje ekosystém, kde AI funguje zodpovědně, eticky a v nejlepším zájmu všech zúčastněných stran.

Koho přesně se tedy AI Act týká?

Jakýkoli AI systém, který je buď prodáván nebo nabízen na trhu EU, uveden do provozu nebo využíván v rámci hranic EU, spadá do působnosti AI Act. Ať už je to místní vývojář prodávající svůj inovativní AI software, nebo globální technologický gigant zpřístupňující své AI služby evropským uživatelům, tento akt zajišťuje, že všechny AI snahy hrají podle stejných etických a bezpečnostních standardů.

Nejde jen o to, kde sídlí vývojáři AI nebo kde jsou AI nástroje v provozu; jde to nad geografické hranice. Bere v úvahu scénáře, kdy je výstup vyrobený AI systémy využíván v rámci EU. To znamená, že i když je AI systém provozován nebo hostován mimo EU, pokud se jeho výsledky používají v rámci Unie, AI Act se použije.

Mluvili jsme o tom, co dělá a koho se týká, nyní si povíme o „jak“. AI Act zavádí systematický mechanismus kategorizace rizik a kategorizuje AI systémy do čtyř odlišných rizikových kategorií, každá s konkrétními důsledky a regulačním zaměřením:

1. Nepřijatelné riziko: AI systémy spadající do této kategorie jsou přímo zakázány. Tyto systémy představují významný potenciál škody, jako je manipulace s chováním prostřednictvím podprahových zpráv nebo zneužívání zranitelností založených na věku, zdravotním postižení nebo socioekonomickém postavení. Kromě toho jsou AI systémy zapojené do sociálního skórování (hodnocení jednotlivců na základě jejich sociálního chování) přísně zakázány.

2. Vysoké riziko: Systémy kategorizované jako vysoce rizikové podléhají nejpřísnějším předpisům. Tato kategorie zahrnuje AI systémy používané v aplikacích kritických z hlediska bezpečnosti (jako jsou zdravotnické prostředky nebo biometrická identifikace) a v konkrétních citlivých sektorech, jako je vymáhání práva, vzdělávání a přístup k základním službám. Regulační zaměření klade důraz na zajištění souladu s předem definovanými standardy, transparentnost, lidský dohled a dokumentační postupy ke zmírnění potenciálních rizik.

3. Omezené riziko: AI systémy s omezeným potenciálem manipulace spadají do této kategorie. Ačkoli nejsou tak přísně regulovány jako vysoce rizikové systémy, jsou povinny dodržovat povinnosti transparentnosti. Příklady takových systémů zahrnují AI systémy, kde je třeba zveřejnit interakci s uživateli (jako jsou chatboty), což zajišťuje jasnost a porozumění zapojení AI v procesu.

4. Minimální/žádné riziko: Tato kategorie zahrnuje AI systémy představující minimální nebo žádné riziko pro jednotlivce (například některé videohry a spam filtry). Tyto systémy vyžadují méně předpisů ve srovnání s ostatními kategoriemi. Pro tyto systémy AI Act nevyžaduje rozsáhlý dohled ani přísná opatření pro soulad kvůli jejich zanedbatelnému dopadu na zdraví, bezpečnost nebo základní práva.

Pochopení kategorizace je pro organizace zásadní pro přesné posouzení jejich AI systémů. Zajišťuje sladění s ustanoveními aktu a umožňuje firmám přijmout nezbytná opatření a strategie souladu relevantní pro konkrétní rizikovou kategorii jejich AI systémů.

Vysoce rizikové AI systémy čelí podle AI Act největším povinnostem a vyžadují soulad s komplexní sadou standardů k zajištění bezpečnosti, přesnosti a ochrany základních práv občanů EU. Konkrétní požadavky pro tyto systémy zahrnují:

Vývojáři vysoce rizikových AI systémů musí stanovit robustní protokoly řízení rizik. To zahrnuje systematické posouzení potenciálních rizik spojených s nasazením AI systému, implementaci postupů správy dat zajišťujících kvalitu dat a udržování podrobné dokumentace popisující vývoj, funkci a provoz AI systému.

Vysoce rizikové AI systémy musí poskytovat jasné informace, zejména při interakci s uživateli, což jim umožní pochopit a uznat, že interagují s AI systémem. Kromě toho je nezbytný lidský dohled k monitorování a zásahu, kde je třeba. Standardy přesnosti také hrají důležitou roli a zajišťují spolehlivost a správnost výstupů AI systému.

AI systémy ve vysoce rizikové kategorii musí být také registrovány ve veřejné databázi v rámci celé EU, což umožňuje lepší dohled, sledovatelnost a odpovědnost v rámci regulačního rámce EU.

Vývojáři pracující s vysoce rizikovými AI systémy musí implementovat opatření kybernetické bezpečnosti k řešení jedinečných zranitelností. To zahrnuje obranu proti pokusům o „otravu dat“ (data poisoning), které poškozují trénovací data, ochranu před „adversariálními příklady“ zaměřenými na oklamání AI a řešení vrozených chyb modelu.

Jak se AI Act blíží k přijetí, organizace musí proaktivně posoudit své AI systémy, aby zajistily soulad s požadavky aktu.

Ustanovení AI Act mohou pro firmy představovat výzvy, zejména v sektorech silně závislých na AI technologiích. Soulad vyžaduje významné úpravy stávající správy AI, postupů řízení rizik a dokumentačních postupů.

Zatímco čekáme na to, až bude vyjednána a zveřejněna konečná verze AI Act, zde je to, co mohou organizace v blízké budoucnosti očekávat:

Sebehodnocení: Organizace by měly provést důkladné hodnocení svých AI systémů proti rizikovým kategoriím AI Act. Pochopení, kam každý systém spadá v rámci těchto rizikových kategorií, je klíčové. Toto sebehodnocení určí úroveň potřebného souladu a odpovídající povinnosti, které je třeba splnit podle AI Act.

Pochopení a kategorizace AI systémů: Správná kategorizace AI systémů zajišťuje sladění s konkrétními požadavky a povinnostmi podrobně popsanými v AI Act.

Příprava na přechodné období: S 18měsíčním přechodným obdobím, které poskytuje přechodnou fázi, by organizace měly tento čas efektivně využít. Upřednostněte interní audity a hodnocení AI systémů k identifikaci potenciálních mezer mezi stávajícími postupy a požadavky AI Act. Vyvinujte a iniciujte strategie k překlenutí mezer, abyste zajistili hladký přechod do plného souladu.

Struktury dohledu a spolupráce: Stanovte v rámci své organizace struktury věnované dohledu nad správou AI, řízení rizik a souladu.

Hlášení incidentů: Důraz AI Act na hlášení incidentů a poprodejní monitorování vyžaduje strategie pro sledování a zlepšování bezpečnosti AI. Organizace se musí připravit na efektivní řízení a hlášení incidentů, čímž zlepší své postupy návrhu, vývoje a nasazení AI na základě poznatků získaných z těchto incidentů.

Safetica se specializuje na opatření kybernetické bezpečnosti a poskytuje nezbytnou podporu při navigaci složitostmi souladu s AI. Naše řešení prevence ztráty dat (DLP) nabízejí přizpůsobené přístupy a vybavují společnosti nezbytnými nástroji k informovaným rozhodnutím ohledně integrace špičkových AI technologií.

Schopnosti proaktivního blokování a hodnocení rizik Safetica slouží jako bašta pro organizace, posilují jejich postoj k zabezpečení dat a zajišťují odpovědné využití AI nástrojů na pracovišti. Využitím odbornosti a nástrojů Safetica mohou firmy s důvěrou využívat potenciál pokročilých AI technologií a zároveň chránit citlivé informace.

S podporou Safetica mohou společnosti vytvořit robustní strategii, která je v souladu s přísnými požadavky EU AI Act, zajišťuje soulad a ochranu dat v měnící se digitální krajině.

Jaké jsou trendy v kybernetické bezpečnosti pro rok 2024? Cloudová ochrana dat, stínové IT a rostoucí využití AI v zabezpečení dat. Podívejte se na...

Safetica nabízí proaktivní přístupy a přístupy založené na riziku k řízení používání nástrojů generativní AI (GenAI) v organizacích.

Polo-volné Wi-Fi je situace, kdy společnost svým zaměstnancům poskytuje téměř volný přístup k Wi-Fi – spolu s několika monitorovacími pojistkami nad...