Previsões da Safetica sobre proteção de dados para 2024

Quais são as tendências em cibersegurança para 2024? Proteção de dados baseada na cloud, shadow IT e crescente utilização de IA na segurança de...

A iminente adoção do EU AI Act é o início de uma era transformadora na governação da IA. Enfatiza uma abordagem baseada no risco para regular a implementação e utilização de sistemas de IA em toda a União Europeia, mas terá implicações a nível mundial.

Este diploma assume importância porque irá impactar como as empresas navegam no mundo da inteligência artificial, e a conformidade não será caminhada de domingo. Tal como uma equipa estuda o regulamento antes de um jogo, as empresas têm de se familiarizar com o AI Act para garantir que estão a jogar segundo as regras e a evitar quaisquer sanções quando o período de carência do AI Act terminar (previsto para o final de 2025 ou início de 2026).

Comecemos pelo princípio. O que é o EU AI Act, qual é o seu âmbito e como podem as organizações preparar-se para ele?

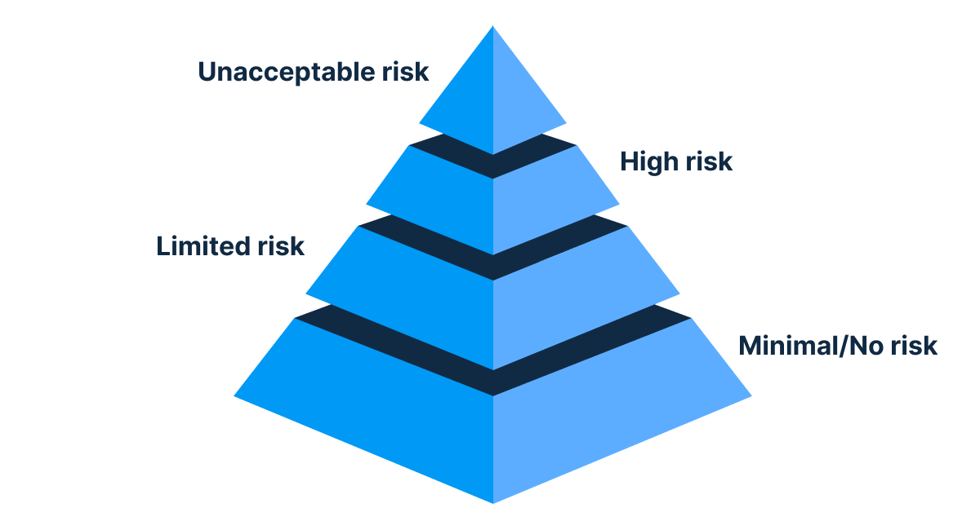

À semelhança do General Data Protection Regulation (GDPR), que trouxe leis abrangentes de proteção de dados à UE, o AI Act visa estabelecer orientações para tecnologias de IA, abordando os riscos potenciais associados à inteligência artificial. Notavelmente, este regulamento adota uma abordagem baseada no risco, categorizando os sistemas de IA com base no nível de risco que apresentam.

É importante notar que o AI Act não tem que ver com proteger o mundo de teorias da conspiração imaginadas ou cenários rebuscados. Em vez disso, foca-se em avaliações de risco e regulamentação práticas que abordam ameaças ao bem-estar e aos direitos fundamentais das pessoas.

O percurso legislativo deste regulamento histórico começou com a sua proposta em abril de 2021. Desde então, foi alvo de discussões rigorosas, negociações e refinamentos dentro dos órgãos legislativos da UE. O Parlamento Europeu deu-lhe luz verde em junho de 2023, e está previsto que seja finalizado no início de 2024.

Uma vez adotado, o AI Act iniciará um período de transição de pelo menos 18 meses antes de ser plenamente aplicado. Durante este período de carência, empresas e organizações apressar-se-ão a alinhar os seus sistemas e práticas de IA com os requisitos descritos no AI Act.

O ato impactará não só as entidades dentro da UE, mas também os fornecedores globais que vendam ou disponibilizem os seus sistemas a utilizadores da UE. Mais uma vez, tal como o GDPR, é um regulamento criado pela e para a UE, mas terá impacto em organizações em todo o mundo.

Embora possa parecer que a UE se está a preparar para uma batalha contra robots a tomar o mundo, a verdadeira finalidade do AI Act é mais prosaica: salvaguardar a saúde, a segurança e os direitos fundamentais das pessoas que interagem com sistemas de IA. Procura manter um ambiente equilibrado e justo para a implementação e utilização de tecnologias de IA.

Imagine-o como um livro de princípios orientadores, garantindo que os sistemas de IA jogam segundo as regras, cumprem orientações éticas e priorizam o bem-estar dos utilizadores e da sociedade. Funciona como medida proativa para impedir que a IA se torne num cenário de Velho Oeste, onde tudo é permitido, e em vez disso fomenta um ecossistema em que a IA opera de forma responsável, ética e no melhor interesse de todas as partes envolvidas.

Então, a quem se aplica exatamente o AI Act?

Qualquer sistema de IA que esteja a ser vendido ou oferecido no mercado da UE, posto em serviço ou utilizado dentro das fronteiras da UE cai no âmbito do AI Act. Quer se trate de um programador local que vende o seu inovador software de IA ou de uma gigante tecnológica global que disponibiliza os seus serviços de IA a utilizadores europeus, este ato garante que todos os esforços de IA jogam pelas mesmas normas éticas e de segurança.

Não se trata apenas de onde estão sediados os programadores de IA ou de onde as ferramentas de IA estão em operação; vai além das fronteiras geográficas. Tem em consideração cenários em que o resultado produzido por sistemas de IA é utilizado dentro da UE. Isto significa que, mesmo que um sistema de IA seja operado ou alojado fora da UE, se os seus resultados forem usados dentro da União, o AI Act aplicar-se-á.

Falámos do que faz e a quem se aplica; falemos agora do "como". O AI Act introduz um mecanismo sistemático de categorização do risco, classificando os sistemas de IA em quatro categorias de risco distintas, cada uma com implicações específicas e foco regulamentar próprio:

1. Risco inaceitável: Os sistemas de IA que se enquadram nesta categoria são pura e simplesmente proibidos. Estes sistemas apresentam um potencial significativo de dano, como a manipulação de comportamentos através de mensagens subliminares ou a exploração de vulnerabilidades baseadas em idade, deficiência ou estatuto socioeconómico. Adicionalmente, os sistemas de IA envolvidos em pontuação social (avaliação de pessoas com base no seu comportamento social) são estritamente proibidos.

2. Alto risco: Os sistemas categorizados como de alto risco estão sujeitos às regulamentações mais rigorosas. Esta categoria inclui sistemas de IA usados em aplicações críticas de segurança (como dispositivos médicos ou identificação biométrica) e em setores específicos sensíveis como aplicação da lei, educação e acesso a serviços essenciais. O foco regulamentar enfatiza a garantia de conformidade com normas predefinidas, transparência, supervisão humana e práticas de documentação para mitigar riscos potenciais.

3. Risco limitado: Os sistemas de IA com potencial limitado de manipulação enquadram-se nesta categoria. Embora não sejam tão estritamente regulados como os sistemas de alto risco, têm de cumprir obrigações de transparência. Exemplos destes sistemas incluem aqueles em que a interação com utilizadores tem de ser divulgada (como chatbots), garantindo clareza e compreensão do envolvimento da IA no processo.

4. Risco mínimo/nulo: Esta categoria abrange sistemas de IA que apresentam risco mínimo ou nulo para as pessoas (por exemplo, alguns videojogos e filtros de spam). Estes sistemas exigem menos regulamentação em comparação com as outras categorias. Para estes sistemas, o AI Act não impõe supervisão extensa nem medidas de conformidade rigorosas devido ao seu impacto negligenciável na saúde, segurança ou direitos fundamentais.

Compreender a categorização é fundamental para que as organizações avaliem os seus sistemas de IA com precisão. Garante o alinhamento com as estipulações do ato, permitindo às empresas adotar as medidas e estratégias de conformidade necessárias e pertinentes para a categoria de risco específica dos seus sistemas de IA.

Os sistemas de IA de alto risco enfrentam o maior número de obrigações ao abrigo do AI Act, exigindo conformidade com um conjunto abrangente de normas para garantir a segurança, a precisão e a proteção dos direitos fundamentais dos cidadãos da UE. Os requisitos específicos para estes sistemas incluem:

Os programadores de sistemas de IA de alto risco têm de estabelecer protocolos robustos de gestão do risco. Isto envolve a avaliação sistemática dos riscos potenciais associados à implementação do sistema de IA, a implementação de práticas de governação de dados que garantam a qualidade dos dados e a manutenção de documentação detalhada sobre o desenvolvimento, a função e a operação do sistema de IA.

Os sistemas de IA de alto risco têm de fornecer informação clara, especialmente quando interagem com utilizadores, permitindo-lhes compreender e reconhecer que estão a interagir com um sistema de IA. Adicionalmente, é necessária supervisão humana para monitorizar e intervir quando necessário. As normas de precisão também desempenham um papel importante, garantindo a fiabilidade e correção dos resultados do sistema de IA.

Os sistemas de IA na categoria de alto risco também têm de ser registados numa base de dados pública à escala da UE, permitindo melhor supervisão, rastreabilidade e responsabilização dentro do enquadramento regulamentar da UE.

Os programadores que lidam com sistemas de IA de alto risco têm de implementar medidas de cibersegurança para enfrentar vulnerabilidades únicas. Isto inclui defender-se contra tentativas de "data poisoning" que corrompem os dados de treino, proteger-se contra "adversarial examples" destinados a enganar a IA e abordar falhas inerentes ao modelo.

À medida que o AI Act se aproxima da adoção, as organizações têm de avaliar proativamente os seus sistemas de IA para garantir a conformidade com os requisitos do ato.

As disposições do AI Act podem colocar desafios às empresas, particularmente em setores fortemente dependentes de tecnologias de IA. A conformidade exige ajustes significativos à governação de IA existente, às práticas de gestão de risco e aos procedimentos de documentação.

Enquanto aguardamos a versão final do AI Act ser negociada e publicada, eis o que as organizações podem esperar passar num futuro muito próximo:

Autoavaliação: As organizações devem realizar uma avaliação minuciosa dos seus sistemas de IA face às categorias de risco do AI Act. Compreender em que categoria de risco cada sistema se enquadra é fundamental. Esta autoavaliação determinará o nível de conformidade necessário e as obrigações correspondentes a cumprir ao abrigo do AI Act.

Compreender e categorizar sistemas de IA: Categorizar corretamente os sistemas de IA garante o alinhamento com os requisitos e obrigações específicas detalhados no AI Act.

Preparação durante o período de carência: Com o período de carência de 18 meses concebido para fornecer uma fase de transição, as organizações devem utilizar este tempo de forma eficaz. Priorize auditorias internas e avaliações dos sistemas de IA para identificar potenciais lacunas entre as práticas existentes e os requisitos do AI Act. Desenvolva e inicie estratégias para colmatar lacunas de modo a garantir uma transição fluida para a plena conformidade.

Estruturas de supervisão e colaboração: Estabeleça estruturas dentro da sua organização dedicadas a supervisionar a governação de IA, a gestão de risco e a conformidade.

Notificação de incidentes: A ênfase do AI Act na notificação de incidentes e na monitorização pós-comercialização exige estratégias para acompanhar e melhorar a segurança da IA. As organizações têm de se preparar para gerir e comunicar incidentes eficazmente, melhorando as suas práticas de design, desenvolvimento e implementação de IA com base nas lições retiradas desses incidentes.

A Safetica especializa-se em medidas de cibersegurança e fornece apoio essencial na navegação pelas complexidades da conformidade com a IA. As nossas soluções de Data Loss Prevention (DLP) oferecem abordagens adaptadas, capacitando as empresas com as ferramentas necessárias para tomarem decisões informadas sobre a integração de tecnologias de IA de ponta.

As capacidades de bloqueio proativo e avaliação de risco da Safetica funcionam como um baluarte para as organizações, fortalecendo a sua postura de segurança de dados e garantindo a utilização responsável de ferramentas de IA no local de trabalho. Ao tirar partido da experiência e das ferramentas da Safetica, as empresas podem aproveitar com confiança o potencial das tecnologias avançadas de IA, ao mesmo tempo que salvaguardam informação sensível.

Com o apoio da Safetica, as empresas podem estabelecer uma estratégia robusta que se alinha com os rigorosos requisitos do EU AI Act, garantindo conformidade e proteção de dados num panorama digital em evolução.

Quais são as tendências em cibersegurança para 2024? Proteção de dados baseada na cloud, shadow IT e crescente utilização de IA na segurança de...

Explore o resumo das regulamentações em vigor de 2024 e das próximas para 2025.

A Shadow IT é uma ameaça significativa para a segurança das empresas e as organizações têm de tomar medidas para gerir os seus riscos.